2026年2月17日,随着人工智能生成内容在互联网空间持续扩张,大量低质、空洞甚至荒谬的信息充斥各类平台,引发用户普遍反感与警惕。为表达对这类内容的疏离与批判,网络社群自发衍生出新术语“AI;DR”,用以标记或戏谑那些缺乏实质价值、难以卒读的AI产出文本。

该词源自英文短语“AI, didn’t read”的缩写,直译为“AI生成,不予阅读”,其构词逻辑借鉴了广为人知的网络简写“TL;DR”(Too Long; Didn’t Read)。这一表达最初在社交平台Threads上的一组讨论帖中出现,随后迅速扩散,成为用户识别、规避及调侃低质AI内容的通用标签。

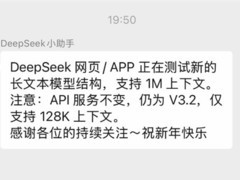

现实中,此类内容形态多样:如某视频生成模型产出的逻辑断裂、物理失真的影像片段;职业社交平台上批量涌现的伪深度、无出处的所谓“行业洞察”;以及搜索引擎结果中反复出现的似是而非、无法验证的陈述。这些现象共同指向一个日益凸显的问题——人工智能正以前所未有的效率,制造海量缺乏事实根基与人文温度的数字信息。

早在2025年,韦氏词典已将“slop”列为年度词汇,重新定义为“由人工智能大规模生成的低质量数字内容”。这一选择不仅反映语言对现实的敏锐捕捉,更印证了公众与行业对AI内容泛滥问题的深切共识。

究其成因,技术门槛持续降低、内容生产者逐利倾向加剧,以及平台算法对流量与停留时长的单一偏好,三者交织作用,加速了低质AI内容的滋生与传播。其后果远超信息过载本身:真实信息被稀释、可信信源被淹没,人与信息之间的判断链条不断弱化,网络空间中真实与虚构的边界日渐模糊。

面对这一挑战,多方已启动系统性应对。部分音频平台对AI生成音频内容施加明确标识,并优化推荐机制,降低其曝光权重;主流搜索引擎与短视频平台亦公开承诺将部署可验证的内容水印技术。与此同时,多家科技企业联合发起C2PA开放标准,通过在数字内容中嵌入不可篡改的元数据,实现生成主体、修改历史与创作路径的可追溯,从而为区分人工创作与AI生成提供底层支撑,助力构建更清晰、更可信的数字内容生态。

评论

更多评论