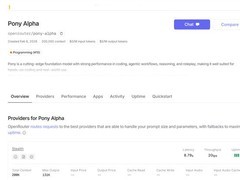

当前人工智能技术持续加速演进,全球主要科技企业均已推出具有代表性的大模型产品。然而在表面繁荣之下,新型安全风险正悄然浮现。近期有权威机构发出警示,指出部分投入巨大资源研发的先进AI模型正成为网络攻击者的重要目标,其中一款主流模型已多次遭遇系统性调用与数据提取行为。

最新核查结果显示,该模型在过去一段时间内被实施了多轮非授权调用,攻击者通过精心设计的提示语触发模型响应,累计恶意唤醒次数逾十万次。

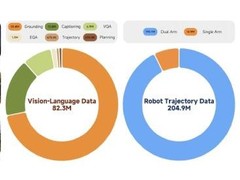

此类行为已被界定为“模型调取攻击”。其典型操作路径是:攻击者以合法身份注册平台账户,在获取基础访问权限后,隐蔽开展对成熟机器学习模型的深度探测,继而有针对性地诱导模型输出可用于构建新训练体系的关键信息,包括但不限于模型结构特征、推理逻辑偏好、参数响应规律等高价值内容。

值得注意的是,实施此类攻击所需成本远低于企业研发同类模型所投入的算力、数据与人力成本,但其潜在危害却极为突出——不仅可能削弱原模型的技术壁垒,还可能加速同质化模型的泛滥,对整个行业的创新生态与安全秩序构成实质性威胁。相关风险亟需开发者群体高度重视,并采取切实有效的防护策略。

评论

更多评论