2026年4月24日,DeepSeek正式发布全新一代大语言模型DeepSeek-V4预览版,并同步开源。该模型具备百万级Token上下文处理能力,在智能体(Agent)功能、世界知识覆盖广度及复杂推理性能等方面,均达到国内领先水平,并在开源模型阵营中位居前列。

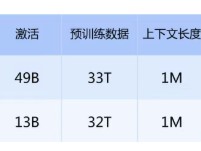

本次发布的DeepSeek-V4预览版包含Pro与Flash两个版本,均原生支持100万Token上下文长度,显著突破传统长文本理解与生成的技术边界。模型新增多项面向企业场景的实用能力,包括可切换的思考模式、结构化JSON输出、工具调用接口、对话前缀续写等。在非思考模式下,FIM代码补全功能亦可稳定启用,全面适配软件开发、日常办公、法律文书处理、金融分析等高复杂度任务需求。

以中文文本为例,100万Token上下文约等效于一次性处理75万字内容,相当于完整承载三体三部曲的全部文字体量,为深度阅读、长文档分析与多轮逻辑推演提供了坚实基础。

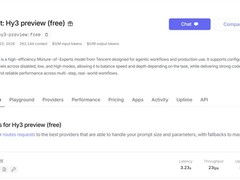

API服务同步完成升级,全面兼容OpenAI与Anthropic两大主流接口协议。开发者仅需将请求中的model_name参数替换为deepseek-v4-pro或deepseek-v4-flash,即可实现无缝接入。原DeepSeek-chat与DeepSeek-reasoner接口将于三个月后终止服务,当前阶段已自动映射至Flash版本,确保平滑过渡。

定价策略延续一贯的普惠原则。Flash版本输入费用按缓存命中情况分为每百万Token 0.2元(命中)与1元(未命中),输出统一为2元;Pro版本对应为1元(命中)、12元(未命中)与24元(输出)。官方提示,受限于高端计算资源供给现状,Pro版本当前并发吞吐量存在阶段性约束;预计今年下半年起,Pro版单位成本将显著下降,进一步推动高性能AI能力向更广泛用户群体开放。

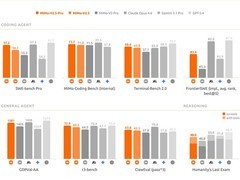

在智能体能力方面,DeepSeek-V4-Pro相较前代实现质的跃升。其在Agentic Coding专项评测中位居开源模型首位,其他Agent相关基准测试结果亦表现突出。目前,该模型已成为DeepSeek内部研发团队开展代码智能体任务的主力模型。

世界知识综合测评显示,DeepSeek-V4-Pro大幅超越现有主流开源模型,在准确性与覆盖度上接近顶尖闭源模型Gemini-Pro-3.1。而在数学推理、STEM学科应用及高水平编程竞赛类任务中,DeepSeek-V4-Pro不仅全面领先所有已公开评测的开源模型,整体表现亦与全球顶级闭源模型处于同一梯队。

评论

更多评论