2026年4月24日,DeepSeek正式发布全新大语言模型系列DeepSeek-V4的预览版本,并同步向全球开源。

该系列模型具备百万级上下文长度,在智能体能力、通用世界知识覆盖及复杂推理性能等方面,均达到国内及开源模型领域的领先水平。

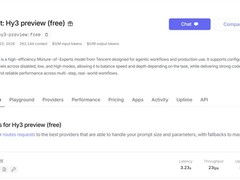

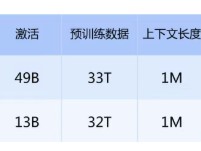

DeepSeek-V4分为两个规格版本:面向高性能场景的DeepSeek-V4-Pro,以及侧重响应效率与成本效益的DeepSeek-V4-Flash。用户可通过API接口调用,仅需将model_name参数设置为deepseek-v4-pro或deepseek-v4-flash即可启用相应模型。

技术层面,DeepSeek-V4创新性地引入一种基于token维度的动态压缩注意力机制,并融合自主研发的DSA稀疏注意力技术,显著提升长文本建模能力。在同等上下文长度下,计算开销与显存占用较传统方案大幅下降。自此,百万级上下文支持将成为DeepSeek全系官方服务的统一标准。

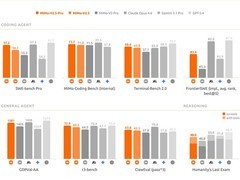

DeepSeek-V4-Pro在智能体任务中表现尤为突出。在Agentic Coding专项评测中,其综合得分位居当前所有开源模型首位;在多项主流智能体能力测试中亦稳居前列。该模型已全面部署于公司内部研发流程,作为主力Agentic Coding工具投入使用。实测反馈显示,其交互流畅度与任务完成质量优于Sonnet 4.5,交付结果稳定性接近Opus 4.6非思考模式,但在需要深度链式推理的复杂场景中,与Opus 4.6思考模式仍存在阶段性差距。

在世界知识类评测中,DeepSeek-V4-Pro大幅领先其他开源模型,整体表现仅次于顶尖闭源模型Gemini-Pro-3.1。

数学、STEM领域及高难度编程竞赛类任务评测结果表明,DeepSeek-V4-Pro已超越所有已公开测评的开源模型,综合能力与全球顶级闭源模型处于同一梯队。

DeepSeek-V4-Flash则在保持强劲推理性能的同时,优化了模型结构与激活规模,从而实现更低延迟、更高吞吐的API服务能力。其世界知识覆盖广度略低于V4-Pro,但在多数常规任务中推理准确率高度接近;在智能体任务评测中,简单任务表现与V4-Pro基本一致,复杂任务处理能力尚有提升空间。

评论

更多评论