距离四月结束仅剩一周,各大人工智能模型研发机构近期密集推出新版本或重要升级,其中DeepSeek V4的发布备受关注,迟迟未现身令业界期待已久。

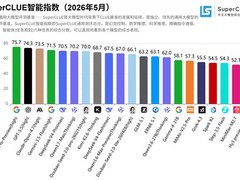

公众最关心的,是此次更新能否通过突破性技术,推动国产大模型跻身全球第一梯队——即便未必登顶,至少应具备与国际领先闭源模型同台竞技的实力。

近日,普林斯顿大学博士生Yifan Zhang在社交平台公开了DeepSeek V4的技术参数。根据披露,该模型分为两个版本:完整版参数量达1.6万亿,Lite版为2850亿,与此前多方流传的信息基本一致。

在核心架构方面,模型采用DSA2注意力机制,整合了DeepSeek V3及R1中已验证的DSA设计,并引入今年初论文提出的NSA稀疏注意力方案。混合专家系统(MoE)启用Mega内核结构,每层配置384个专家,每次推理激活其中6个。残差连接部分沿用此前论文提出的Hyper-Connections方案,该设计亦见于近期DeepGemm优化更新中。

训练与后端优化层面同样引入多项新技术:优化器选用Muon;强化学习阶段采用GRPO算法,并辅以KL散度校正;预训练上下文长度由此前的32K大幅提升至100万token。

值得注意的是,尽管DeepSeek过往版本更新中曾多次暗示将拓展视觉能力,迈向多模态方向,但此次披露内容仍将其明确定义为纯文本大模型,这一设定略显意外。

整体来看,该技术信息覆盖面广,但来源非官方研发团队成员,部分内容疑似整合自网络已有线索与零散公开资料,虽多数细节与此前行业观察和官方释放的信号相吻合,尚无法独立验证其全部准确性。

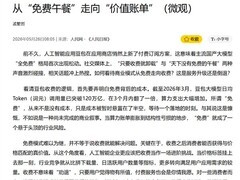

自DeepSeek R1发布已过去十五个月,距V3.2最终版也已逾五个月。在此期间,主流大模型厂商普遍完成至少一次大版本迭代及数次小版本优化。对DeepSeek而言,V4的延迟发布无形中加剧了竞争压力——发布时间越靠后,市场期待越高,容错空间越小。

目前,业界普遍期盼能在下周迎来DeepSeek V4完整版与Lite版的正式上线。

评论

更多评论