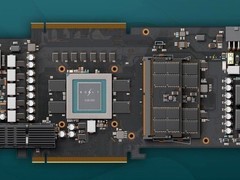

2026年4月1日,业内公认推动高带宽内存技术发展的关键学者金正浩指出,人工智能计算的核心驱动力正在发生深刻变化——主导权正加速从图形处理器向内存系统转移。

随着人工智能从生成式阶段迈入智能体阶段,系统需实时调度、关联并推理海量文本、音视频及多模态数据,对上下文处理能力提出前所未有的要求。在此背景下,内存已不再是传统意义上的辅助单元,而成为决定AI性能上限的关键瓶颈。

为支撑智能体所需的复杂上下文工程,内存的带宽与容量必须实现质的飞跃。据估算,相较当前主流配置,相关指标需提升最高达一千倍;当输入数据规模扩大百倍至千倍时,内存资源需求可能呈指数级膨胀,极端情况下甚至可达百万倍量级。

金正浩认为,当前以堆叠动态随机存取存储器为基础的高带宽内存技术,虽已在大模型训练中发挥重要作用,但面对智能体时代持续增长的数据吞吐与长期存储需求,其物理极限与成本结构将逐渐显现制约。他特别强调,高带宽闪存技术将成为下一阶段的重要突破口。

该技术通过垂直堆叠NAND型闪存芯片,构建起兼具超高密度与稳定性的长期存储架构,其容量优势较传统方案实现数量级提升,可类比为一座高效运转的巨型数字书架。

这一演进或将重塑整个AI基础设施的权力分布:计算重心正从处理器向内存迁移。未来系统的设计逻辑或将发生根本性转变——不再以GPU或CPU为绝对核心,而是以超大规模内存体系为基座,处理器则作为嵌入其中的功能模块,按需调用、协同运作。

产业界对此已有实质性响应。今年2月,一份提交至电气与电子工程师学会的学术论文正式提出“H3架构”,首次将高带宽内存与高带宽闪存进行混合部署。该架构明确区分两类存储的职能:高带宽闪存承担大容量只读数据的持久化存储,而高带宽内存则负责低延迟、高频率的动态计算任务。二者在带宽水平上基本相当,但前者在容量上显著占优,后者在访问延迟、写入寿命与能效方面更具优势。

据预测,高带宽闪存的工程样片有望于2027年前后完成验证,主要AI硬件厂商或将于2028年起启动集成应用。围绕该技术的产业化竞争亦将全面展开,头部存储企业之间的技术路线博弈将再度升级。

评论

更多评论