7月31日,2025年第二届产融合作大会在北京举行。大会期间,浪潮存储发布了其全新推理加速存储产品AS3000G7。该产品针对大模型推理过程中由于KV Cache重复计算引发的算力浪费与时延问题,为金融、科研等行业实现模型规模化部署提供了有力支持。

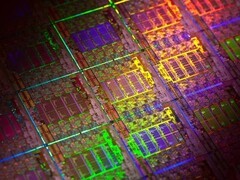

目前,大模型推理主要依赖高成本的GPU服务器,其使用效率直接影响到模型从实验环境向实际应用的转化速度。

根据行业分析机构预测,未来五年内智能算力的总体规模将增长1.7倍,至2027年,推理任务在整体算力需求中的比例将突破70%。因此,如何提高GPU的利用效率成为亟待解决的重要课题。

AS3000G7采用了“以存代算”的创新架构,能够集中存储全部的KV Cache以及多轮对话的结果数据。其核心技术在于,将原本存放在GPU本地内存中的KV Cache,通过高速网络转移至AS3000G7中缓存。在后续的对话过程中,系统可根据需求直接调取已缓存的数据,有效避免了重复计算。

这种突破性设计不仅大幅降低了算力消耗,还显著提升了GPU资源的使用效率,为大模型在更多实际场景中的快速落地提供了关键技术保障。

评论

更多评论