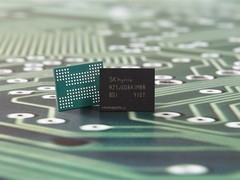

4月29日,阿里云正式发布了Qwen3,并开源了8款混合推理模型。此次开源涵盖了两款MoE模型和六个Dense模型。

在MoE模型方面,包括了Qwen3-235B-A22B(总参数规模超过2350亿,激活参数规模达220多亿),以及Qwen3-30B-A3B(总参数规模为300亿,激活参数规模为30亿)。而在Dense模型方面,则提供了Qwen3-32B、Qwen3-14B、Qwen3-8B、Qwen3-4B、Qwen3-1.7B和Qwen3-0.6B共六款不同规模的模型。

全球开发者、研究机构和企业均可免费下载这些模型并用于商业用途。模型遵循Apache2.0协议开源,用户可以在魔搭社区、HuggingFace等平台获取相关资源。此外,也可以通过阿里云百炼调用Qwen3的API服务。个人用户可以通过通义APP直接体验Qwen3的功能,不久后还将在夸克中全面接入Qwen3。

Qwen3支持多达119种语言和方言,具备广泛的多语言处理能力。同时,该模型提供了两种思考模式:一种是“思考模式”,适用于需要深度分析的复杂问题;另一种是“非思考模式”,则更适合对速度要求较高的简单任务。这种灵活的设计让用户能够根据具体任务需求调整模型的“思考”深度,从而在成本与性能之间实现更优的平衡。

据官方介绍,旗舰级模型Qwen3-235B-A22B在代码编写、数学计算和通用能力等多个基准测试中,表现出色,与多款国际顶级模型相比具有较强的竞争力,性能超越了部分知名大模型。而小型MoE模型Qwen3-30B-A3B的激活参数数量仅为Qwen3-32B的10%,但性能却更为优异。此外,即使是像Qwen3-4B这样的小型模型,也能达到与Qwen2.5-72B-Instruct相近的性能水平。

对于部署场景,阿里云建议使用SGLang和vLLM等框架;而在本地运行方面,则推荐Ollama、LMStudio、MLX、llama.cpp和KTransformers等工具,以满足不同用户的需求。

评论

更多评论