距离四月下旬已不足数日,DeepSeek V4大模型的发布节奏持续引发关注。就在昨日,该公司研究人员悄然更新了DeepGEMM算子库,这一动作被业内普遍视为V4临近发布的信号之一。

为避免外界过度解读,团队在更新后特别补充说明:此次调整仅聚焦于DeepGEMM底层算子的开发与优化,与内部大模型的发布时间表无直接关联。换言之,该次技术演进并非V4即将推出的明确预告。

但恰恰是这类克制的澄清,反而进一步激发了公众对V4的期待。原因在于,本次DeepGEMM升级本身亮点突出,多项关键技术改进与大模型架构演进高度契合,很难不让人联想到V4的底层支撑逻辑。

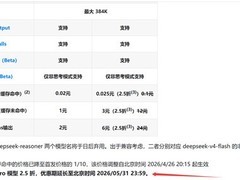

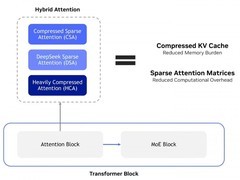

具体来看,此次更新在精度支持方面新增FP8_FP4混合计算能力,并深度适配NVIDIA Blackwell架构;在结构层面则重点引入Mega MoE与HyperConnection两大新机制。其中,Mega MoE尤为关键,有望推动MoE架构实现质的跃升。

根据公开分析,Mega MoE将显著提升单次推理中被激活的专家数量。相较V3版本固定启用256个专家,V4预计可动态调度数千个专家单元,在保障模型响应灵活性的同时,大幅增强表达能力与推理质量,且对计算资源和显存占用的增幅控制在合理区间。

更值得关注的是,此次算子库更新所透露的参数规模线索也日趋清晰。有分析指出,V4单层MoE结构参数约为25.37B,若沿用60层设计,整体参数量将达约1.6万亿;即便采用48层结构,参数总量亦可达1.25万亿。相较此前市场普遍预期的1万亿参数,1.6万亿意味着提升幅度达60%,性能潜力远超原有预估。

即便最终落地版本为1.25万亿参数,也已较V3的6700亿实现翻倍增长。叠加Mega MoE带来的数千专家协同机制,V4不仅将刷新MoE类大模型的技术边界,更可能成为该架构发展进程中具有标志意义的一次跨越。

评论

更多评论