养龙虾最近已经登上各大平台的热门榜,各种消息铺天盖地,仿佛不接触这最新技术,你就会掉队。对于普通人来说,事实真的如此吗?

龙虾是什么

为何还要去养它

龙虾就是OpenClaw,它是一款开源的AI智能体框架,因图标有一只红色龙虾所以才被如此称呼。

OpenClaw定位为AI智能体的骨架,也可以理解为操作系统,本身并不带有大模型,但具备将各类大模型及AI插件整合在一起协同作业。

目前市面上许多传统的AI应用或工具,基本上都是基于某一个方向,比如纯文字、图片生成、视频生成等。

OpenClaw强大之处就在于,用户的一句需求中可能需要调用多个不同领域的AI应用,部署整合后的OpenClaw就能基于用户指令直接完成多维的复杂需求。从点到点衍变成点到面。

现在来聊聊“养”该怎么理解。这里有两层意思,第一层就是需要给OpenClaw装配各种插件。各类AI插件应用五花八门,也使得这只龙虾完全基于使用者的个人工作需求来定制。

第二层意思就是用户需要不断的训练这只龙虾,使它越来越强,越来越了解你的习惯。就比如多次指令训练且对其布置任务后对产出的结果进行评价和改进方式。

如果探讨OpenClaw是否强大?毋庸置疑,这是非常出色的AI技术升级。龙虾具备非常高的上限,但为什么依然不推荐普通用户盲目拥抱它?

算一笔账

需求、费用、投入产出比

先问2个问题:

1、你是否有足够的需求让自己一定要借助OpenClaw?

2、你愿意花多少时间教它做事?

对于大多数普通用户来说,答案可能是:并没有那么多刚需场景和精力。

如果说需求问题是有没有必要养,那费用问题就是养不养得起。

现阶段使用OpenClaw获得比较好的体验,或者是达到无需操心的自动化解决需求工作,基本上都要接入付费模型的API才行。每次向你的龙虾下达的指令,就代表要向模型厂商支付Token费用,这才是养虾人需要支付的“养殖成本”。

除此之外,如果用户并不懂AI智能体或不具备一定的PC软硬件知识,那么还需要加上如MacMini或PC硬件以及龙虾安装部署费用。在还未确切的完成一个需求之前便已经开始库库爆金币了。

OpenClaw虽然本身是开源免费的,但对于没有技术背景的普通人来说,光是把它请进门,就已经是一道需要付费跨越的门槛。

在二手交易平台上,OpenClaw的远程安装服务价格从几十元到数百元不等,上门服务则普遍在500元至1500元之间。

除此之外,由于OpenClaw存在安全隐患,许多开发者建议不要在主力电脑上部署。这直接带动了苹果Macmini的热销,让哪怕是二手设备也水涨船高。

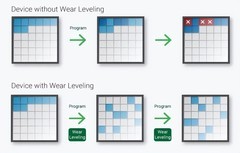

OpenClaw的Token消耗量是普通大模型的数倍甚至上百倍。因为它执行任务时会进行任务分解与编码:搜资料、写代码、调试、优化,每一步都要与大模型进行多轮交互,每一步都在字面意思的烧钱。

目前,已有越来越多的受害者用户在网上开始诉苦。用于支付Token的费用已远大于实际产出的价值。

OpenClaw的使用群体

一类是那些工作中充斥着大量重复性操作的人,比如每天需要从十几个网站收集数据、定时整理报表的分析师,或者需要批量处理文档、同步多平台信息的运营人员。

另一类是具备一定技术背景的玩家。OpenClaw虽然号称零门槛,但实际使用中,你需要面对命令行、配置文件、API密钥,一个报错信息可能就让普通人卡住半天。

懂编程的人,可以把OpenClaw当作一个可扩展的工具箱,让它帮自己写代码、调程序,甚至用它批量管理服务器。对这类群体来说,养虾本身就是一种乐趣和探索。

当然,也有一类纯粹的技术爱好者或研究者,他们未必有明确的需求,但就是愿意为新技术交学费,想亲手摸一摸AI能力的边界。第一时间接触前沿的AI场景化应用。

说到底,当下层出不穷的AI应用本质都是工具。工具的价值在于服务人,而不是让人去服务工具。如果为了追热点,花大量时间、金钱和精力去折腾一个自己根本用不上的东西,那就本末倒置了。

真正的AI时代,不是比谁装的工具多、谁追的热点新,而是比谁能用最合适的工具解决自己的问题。如果现有的AI产品已经能更高效的解决需求,那自然更加方便。

对于大部分普通人以及需求量来说,与其养虾,不如直接使用市面成熟的AI产品。不论是用扣子进阶AI智能体,还是图文、视频生成的工作,都是更具性价比的选择。

如果你在仔细算完前面那笔账后,依然对AI自动化抱有浓厚的兴趣,或者你本身就是一个需要频繁折腾大模型的技术玩家,那么可以借助映众RTX5060 Ti 8GB超级冰龙创建一个私人虾塘了。

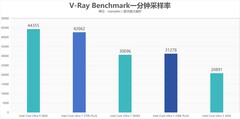

RTX5060 Ti 8GB超级冰龙搭载的第五代TensorCore能够提供高达998AI TOPS的算力。这个数字可能有点抽象,换个说法:相当于在个人PC里内置了一个可以24小时不间断运行的助手。

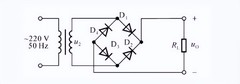

以前你需要把数据传到云端,让大模型厂商的超级计算机帮你算,然后按Token付费。现在,很多轻量级的AI模型可以直接在本地运行,推理速度快,没有API费用,更不用担心数据隐私泄露。

依托全新的NVIDIABlackwell架构,这张显卡对AI的优化是全方位的。它新增了对FP4精度的支持,这是一种更高效的运算方式,能在几乎不损失模型效果的前提下,大幅降低显存占用和计算量,让本地运行大模型变得更加流畅。真正做到我的AI我做主。

评论

更多评论