美团技术团队近日宣布,对DeepSeek R1模型进行了INT8精度量化,使得该模型能够在老型号GPU如A100上进行部署。原生的DeepSeek R1模型权重采用FP8数据格式,这限制了其只能在英伟达的新型GPU上部署,而其他型号的GPU则无法直接支持。

为了解决这个问题,美团搜索和推荐平台部门尝试了对DeepSeek R1模型进行INT8精度量化。结果显示,量化后的模型精度基本保持不变。通过INT8量化,DeepSeek R1突破了芯片限制,现在可以部署在A100等GPU上。此外,与BF16相比,INT8量化还实现了50%的吞吐量提升,从而降低了推理成本。

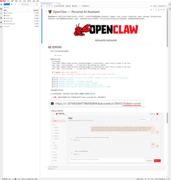

现在,INT8量化代码已经发布在开源LLM推理框架SGLang上,量化模型也已发布至Hugging Face社区,以下是模型链接:

https://huggingface.co/meituan/DeepSeek-R1-Block-INT8

https://huggingface.co/meituan/DeepSeek-R1-Channel-INT8

评论

更多评论