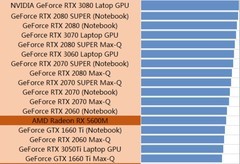

近日,阿里巴巴开源了其首个拥有超过1000亿参数的Qwen1.5-110B语言模型。该模型在基础能力评估中与Meta-Llama3-70B相当,并在Chat评估中表现出色。值得注意的是,Qwen1.5-110B采用了相同的Transformer解码器架构,且支持32K tokens上下文长度,且仍为多语言模型,在英、中、法、西、德、俄、日、韩等语言上均取得良好效果。

尽管没有对预训练方法进行大幅改变,但阿里巴巴表示性能提升主要来自于增加规模。“我们没有对预训练方法进行大幅改变,”阿里巴巴团队成员周龙说,“尽管如此,我们在两个基准测试中的表现已经比以前发布的72亿更好的很多。”

评论

更多评论