2023年,AI风潮席卷全球,所有人都惊叹于CHATGPT的出现,很多人日常的生活与工作,都因AI的普及与出现,得到了众多便捷的工具,无论是AI智能聊天机器人,还是图形、代码上的AI快速生成,都对我们有着一定程度的影响。

而NVIDIA前不久推出的CHATWith RTX,则是一款可以本地部署的专属AI聊天机器人,在你的电脑上就能实现AI功能,通过与大语言模型连接,用检索增强生成(RAG)、NVIDIATensorRT-LLM软件及NVIDIARTX加速技术,即可实现与自己专属的聊天机器人对话。

当然,每个人的CHATWith RTX都是不同的,主要区别与你给AI投放的资料,通过移入自己的文档、笔记、视频或其他数据,CHATWith RTX会通过检索资料内容,快速给予你合适的答案,哪怕是资料不相关的内容,AI也会回答你相对合适的答案。

那我们首先先来简单试验下这个CHATWithRTX,首先是安装问题,软件安装包NVIDIA官网便有得下,但安装过程还是需要下载,且需要一定的科学上网环境,才可完成安装,在安装完成后,需要保持网络环境开启软件即可体验CHATWith RTX。

打开CHATWithRTX,可以发现左上角显示默认采用mistral大模型,右上角则可以选择资料来源(数据集),目前可选的只有文件夹、油管视频以及模型本身的,文件支持txt、pdf、doc,只要放在目标目录下即可(子文件夹也行)。

在默认文件夹中,有着NVIDIA各项技术的文档,那么根据下方提供的问题,首先提问什么是传送门:序曲RTX版,CHATWith RTX会根据文档中传送门的内容,经过大语言模型分析,并给你提供出答案,如果在大量文章中检索需要的内容,那么CHATWith RTX绝对是快捷方便的工具。

目前CHATWith RTX默认的语言只能使用英文回答,若使用中文提问,也可以得出正确的回答,但依旧是以英文的形式,若想加入中文回答,则需为CHATWith RTX加入新的中文模型,这过程稍许复杂,并需要科学上网,详情可参考以下B站视频链接尝试添加。

https://www.bilibili.com/video/BV1DK421b7JX/

那么我们依据上面视频内容,添加了百川的大预言模型后,即可做到中文提问中文回答,资料依旧是文件夹里提供的英文资料,但是不同的是,回答方式改为了中文,更方便国内用户使用。

在文件夹中加入过往的文章,重新加载文件夹内容后,即可完成相关内容的检索,输入后会快速检索内容并进行总结描述。

除了文件夹内容检索外,目前还支持油管视频检索,要求CHATWith RTX详细的介绍该视频内容,经过一段时间分析,就能将视频解析个大概,当然有些部分的准确程度不一定很高,但还是处于可以看的水准。

可以看到,目前CHATWithRTX可以快速分析文档和视频,配合合适的大语言模型,可以给予准确率不错的答案,而且由于是本地部署,回答的内容和提供的资料都没有外泄的可能,在安全性上还是可靠的。不过目前还只是个demo测试版,并且Google后续还会利用NVIDIATensorRT-LLM,优化自家的开放语言模型,以便支持NVIDIAAI平台,相信之后的内容与生态会越来越丰富。

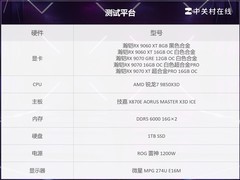

目前想使用NVIDIACHAT With RTX的用户,需要RTX30、RTX40系显卡,其他显卡暂不支持,所以想使用CHATWith RTX的朋友,可以考虑下影驰RTX4070 SUPER金属大师OC显卡。

影驰RTX4070SUPER金属大师OC采用了无灯光设计,外观主要采用金属灰,并拥有很强的金属质感,配合高效的散热器,可以做到高性能、低温度、低噪音,无论是游戏还是AI,都能在高负载下稳定运行,是你研究AI路上的好帮手,喜欢的朋友欢迎来影驰官方商城购入哦~

评论

更多评论