当深夜实验室的屏幕还亮着,一行行训练日志滚动而过,模型收敛曲线缓慢上扬——对AI开发者与研究人员而言,算力不是炫技的参数,而是缩短验证周期、降低试错成本的真实生产力。在模型规模尚未跃升至百亿级的阶段,一颗稳定、兼容性强、驱动成熟且功耗可控的GPU,远比盲目堆叠显存更契合实际研发节奏。尤其在课程教学、小规模数据集微调、CV/NLP基础实验及嵌入式AI原型开发中,显卡需兼顾CUDA生态支持、散热静音表现与整机兼容性,而非一味追求峰值算力。

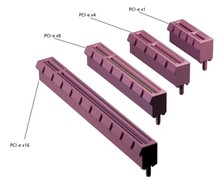

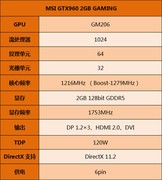

微星GeForce GTX 1660 VENTUS XS C 6G OCV1,到手价仅1899元,是当前AI入门场景中极具策略价值的选择。它基于图灵架构,配备6GB高速GDDR6显存,完整支持CUDA 10.2及以上版本、cuDNN 7.6+及主流深度学习框架,实测可在TensorFlow 2.x与PyTorch 1.10环境下稳定运行ResNet-18、YOLOv5s等中等规模模型。其紧凑型双槽设计适配ITX与MATX迷你工作站,高效风冷系统保障连续8小时训练无降频,功耗控制在120W以内,大幅降低散热与电源冗余压力,特别适合高校实验室批量部署与学生自组开发平台。

耕升RTX 2060 追风,到手价3699元,定位进阶研究辅助。虽属RTX系列,但其6GB GDDR6显存与完整Tensor Core支持,使其在FP16混合精度训练中较GTX1660提速约40%,同时具备NVENC硬编码能力,便于视频类AI项目中的实时流处理与标注加速。驱动长期稳定,NVIDIA Studio认证确保与Blender、Omniverse等科研协同工具无缝衔接,适用于需要兼顾轻量3D仿真与模型可视化的交叉课题组。

技嘉AORUS RTX 2080 8G(6099元)与微星RTX 2080Ti GAMING X TRIO(10888元)则面向更高密度计算场景:前者在单精度浮点性能与显存带宽上实现跃升,可支撑BERT-base微调与中等规模GAN训练;后者凭借11GB大显存与更强光栅化能力,成为多任务并行推理与小批量强化学习仿真的可靠节点,尤其适合需要复用显卡进行渲染+训练联合验证的智能体研究团队。

EVGA RTX 2080 XC Ultra GAMING(13909元)虽定价最高,但其一键超频与军工级供电设计,在持续高负载下仍保持极低核心波动,配合三风扇均热模组,为长时间分布式训练任务提供冗余稳定性,适合对环境容错率要求严苛的工业AI质检平台搭建。

综上,从课堂实践到实验室攻坚,从模型初筛到多模态验证,不同价位段产品并非简单替代关系,而是构成了一条覆盖轻量调试、中度训练与高稳推理的AI算力阶梯。合理匹配任务复杂度与资源约束,方能在有限预算内释放最大研发效能。

评论

更多评论