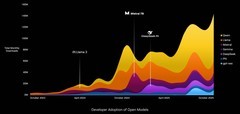

当下,人工智能的进化曲线正在发生质变。当行业还在讨论大语言模型的参数规模时,前沿应用已经转向一个更具挑战性的命题,如何让AI系统不仅能够回答问题,还能独立规划、调用工具、编写代码,并在无人干预的情况下持续运行数小时甚至数天。

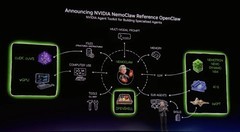

这些被称为“智能体”(Agent)的系统,在NVIDIA新推出的NemoClaw框架下也被赋予了一个特定称谓“Claws”。它们代表AI从“对话式交互”向“任务式执行”的跃迁。但要支撑这种“长思考”模式,传统的开发基础设施显得捉襟见肘,云端GPU集群存在数据安全顾虑和网络延迟,消费级显卡又受限于显存和算力。

NVIDIA在GTC 2026给出的解决方案是DGX Spark。这不是一台简单的工作站升级,而是一个将AI工厂级能力压缩进桌面形态的战略级产品。配合全新发布的NemoClaw开源栈,DGX Spark试图在数据主权、算力密度和部署灵活性之间找到新的平衡点。

四机成阵,打破桌面算力的单机天花板

DGX Spark最显著的技术特性,在于其突破了传统桌面AI设备的性能隔离。

根据NVIDIA官方资料,DGX Spark现已支持通过ConnectX-7将最多四台系统集群化为统一配置,实现“线性性能扩展”。这种设计直接回应了企业开发中的核心痛点:单机性能不足,但传统机架式服务器集群又过于复杂。

NVIDIA提供的测试数据显示,在运行Qwen3 Coder Next模型(FP8精度,32K输入/1K输出上下文长度)时,从单个子代理扩展到四个子代理,提示词处理吞吐量提升2.9倍。这种扩展能力的关键在于NVLink架构的高带宽互联,而非简单的网络堆叠。

“桌面数据中心”的概念由此而来。四台DGX Spark可以在保持桌面级形态的同时,提供接近小型服务器集群的算力密度,且无需面对传统机架部署的复杂性。对于需要频繁迭代、对数据延迟敏感,或受限于数据主权要求无法使用云端资源的团队,这种形态提供了第三种选择。

GB10超级芯片与2000亿参数模型

DGX Spark的核心是NVIDIA GB10超级芯片,这是Grace Blackwell架构在桌面端的呈现。与追求极致单卡性能的游戏显卡不同,GB10的设计哲学明确偏向能效比和内存容量。

NVIDIA官方定位DGX Spark支持“高达2000亿参数”的模型运行。这一数字需要放在具体场景中理解,它并非指训练2000亿参数模型,而是在本地部署和运行经过量化的推理模型。GTC 2026上宣布支持的具体模型包括:Nemotron Super V3 120B(NVFP4格式)、Nemotron-3-Nano-30B-A3B-Omni、Nemotron Nano v2.1 4B、Qwen 3.5、FLUX.2 Klein、LTX 2.3 22B、Sinistea(NVFP4格式)。

即将发布的软件更新将进一步增强编排和可管理性能力,支持企业级的模型部署和监控需求。这意味着DGX Spark正在从开发设备向生产基础设施演进。

NemoClaw与OpenShell:完整的智能体运行环境

谈论DGX Spark时,软件栈的重要性不亚于硬件规格。NVIDIA同步发布的NemoClaw开源栈,重新定义了智能体的开发和部署范式。

NemoClaw的核心是OpenShell运行时,这是NVIDIA Agent Toolkit的组成部分。根据官方描述,它提供了一个“安全环境”,用于运行自主智能体。具体而言,OpenShell定义了智能体如何访问数据、调用工具以及在策略边界内运行——这些功能对于企业部署至关重要。当智能体被授权访问内部系统时,治理和隔离能力比单纯的算力更为关键。

NemoClaw的安装被简化为“单个命令”,这种易用性设计针对广泛的企业开发者群体。配合DGX Spark,开发者可以在本地构建和验证智能体,随后无缝迁移到数据中心的GB300 NVL72系统或云端实例,无需重新架构。

从评估到生产,企业部署的真实轨迹

NVIDIA在GTC 2026上展示了一系列客户案例,显示DGX Spark正从“技术评估”阶段进入“积极的企业部署”。

金融行业的应用聚焦于风险建模。由于涉及敏感交易数据,这类任务过去需要在加密云端环境中进行,数据传输和合规审查往往耗费数天。DGX Spark的本地部署能力使得模型可以在完全隔离的环境中运行,既满足监管要求,又压缩了迭代周期。

媒体和电信团队正在构建实时内容和通信工作流。这类应用对延迟极度敏感,且工作负载波动极大可能在数小时内从空闲状态突进到满负荷。DGX Spark的集群弹性允许平时单机运行节省电力,高峰期快速扩展应对流量洪峰。

软件生态,预装的全栈AI工厂体验

DGX Spark预装了完整的NVIDIA AI软件栈,这是其与消费级PC等设备的本质区别。官方列出的支持工具包括:

基础环境:Anaconda、Docker、Red Hat

模型运行:Ollama、llama.cpp、LM Studio、vLLM、SGLang

开发工具:JetBrains、ComfyUI、Unsloth、Lightning AI

实验管理:Weights & Biases(已被CoreWeave收购)

AI平台:1x、Aible AI、Roboflow

这种生态整合的战略意图在于“一致性”:开发者在DGX Spark上构建的智能体应用,可以无缝迁移到数据中心的GB300系统或云端。对于正处于从“实验阶段”向“规模化部署”过渡的企业,这种平滑演进路径降低了技术风险。

GTC 2026上展示的具体演示包括:Reachy机器人集成、OpenClaw智能体演示、LM Studio on DGX Spark、双机推测解码等。

与DGX Station的协同,分层的产品矩阵

理解DGX Spark的定位,需要将其与同期发布的DGX Station进行对比。

DGX Station被定位为“世界上最强大的桌面超级计算机”,搭载GB300 Grace Blackwell Ultra Desktop超级芯片,提供748GB相干内存和高达20 petaflops的FP4 AI性能,支持高达1万亿参数的模型。它针对的是需要极致算力的AI研究员和数据科学家,支持气隙隔离配置,适合受监管行业和主权环境。

相比之下,DGX Station的客户案例包括:Snowflake(测试Arctic训练框架)、EPRI(AI驱动天气预报)、Medivis(手术工作流视觉语言模型)、成均馆大学(蛋白质结构分析)、微软研究院与康奈尔大学(AI培训)、Respo.Vision、WSP和1X(体育分析、合成数据训练、人形机器人)。

DGX Spark的定位更侧重于“可扩展”和“团队级”部署。其四机集群能力、相对紧凑的形态和针对Always-On场景的优化,使其更适合作为企业各职能团队的AI基础设施。

两者共享统一的软件架构,应用可以在两个平台间无缝迁移。开发者可以在DGX Spark上完成原型验证和中小规模部署,当需要处理更大规模模型时,迁移到DGX Station或数据中心系统。

写在最后

DGX Spark的发布,标志着企业AI基础设施从“云端集中”向“边缘分布”的关键转折。四机集群能力打破了桌面算力天花板,NemoClaw软件栈定义了智能体的安全运行范式,GB10芯片则在能效与性能间找到平衡点。

这三者的组合,解决了一个长期困扰企业AI团队的难题:如何在数据不出域的前提下,获得接近数据中心的开发体验。对于金融、医疗、能源等强监管行业,这不仅是技术选项,更是合规刚需。

当然,DGX Spark的真正考验在于生态落地。硬件已经就绪,但智能体应用能否在企业场景中产生足够的商业价值,将决定其市场天花板。历史经验表明,基础设施的普及往往先于杀手级应用的出现,DGX Spark正处于这个微妙的时间窗口。

无论如何,当2000亿参数模型可以安静地躺在办公桌上运行,当四台设备就能组成线性扩展的AI工厂,企业AI开发的门槛和形态已被重新定义。剩下的问题交给市场:哪些团队能率先将这些桌面算力,转化为真实的业务价值。

评论

更多评论