Python是当前最受欢迎、最易掌握且应用最广泛的编程语言,堪称大数据时代必备技能。其经典数据分析库pandas功能强大,为数据处理提供了高效工具,深受开发者青睐。

1、 导入pandas库以及urllib.request中的urlretrieve函数。

2、 将网站数据下载至本地设备。

3、 es_url与vs_url是STOXX网站上用于下载两份数据的链接地址。

4、 将远程数据通过urlretrieve下载至本地data文件夹,并分别保存为es.txt和vs.txt两个文件,具体效果所示。

5、 清理数据,去除空格。

6、 读取位于指定路径的文本文件,并将其中的所有行内容加载到变量 lines 中。随后对 lines 进行处理,去除每行中的所有空格字符。完成清理后,展示该变量中前六行的数据内容,以验证处理结果。具体执行效果如附图所示。整个过程实现了文件读取、数据清洗与初步查看的功能,便于后续分析与操作。

7、 数据核查(分号冗余)。

8、 遍历 lines 中的每一行并打印,查看第3884至3890行数据时,发现末尾几行多出了若干分号;,具体所示。

9、 数据处理时用分号分隔并添加辅助列。

10、 创建一个新文件用于写入数据,文件路径为C:/Users/*/Documents/data/es50.txt,通过写文件操作实现数据处理。在写入过程中,首先向文件中添加字段名date以及原始数据行内容,并在每行末尾补充标识DEL,表示将原数据最后一列替换为缺失值标记。随后,从原始数据的第5行开始,将其后续所有行内容逐行写入该文件,确保所需数据被完整保留。完成写入操作后,及时关闭文件,以确保数据保存并释放资源。接着,重新打开该文件并读取全部内容,将每一行作为元素存储在列表中,便于后续处理与查看。通过该列表可访问文件中的每一行数据,尤其可用于检查前5行内容是否符合预期格式与要求。整个过程实现了对原始数据的结构调整与部分内容重写,最终生成一个按特定规则处理后的文本文件。所示,操作流程清晰,结果可见。

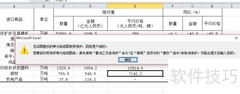

11、 数据格式化处理

12、 从指定路径读取一个文本文件,使用 pandas 的 read_csv 函数将数据加载到程序中。设置参数 index_col=0 表示以第一列作为行索引;parse_dates=True 表示自动识别并解析索引中的日期格式;sep=; 指明数据字段之间以分号进行分隔;dayfirst=True 表示日期采用欧洲常用格式,即日-月-年的顺序优先解析。该文件路径位于本地文档目录下的 data 文件夹中,文件名为 es50.txt。成功导入后,数据被赋值给变量 es。随后引入 numpy 库,利用 np.round 函数对 es 数据的最后五条记录进行四舍五入处理,便于观察数值的近似情况。通过调用 tail() 方法获取数据末尾部分,默认显示五行,结合 round 函数可清晰查看各数值经取整后的结果。整个过程实现了从文件读取、日期解析到数据展示的完整流程,最终输出形式简洁直观,有助于快速了解数据结尾部分的主要特征和趋势表现。

13、 删除多余辅助列以优化数据处理。

14、 删除多余辅助列后,通过es.info()查看数据信息,具体结果所示。

15、 数据导入的另一种方式。

16、 从数据结构的角度分析,cols代表了所需提取的列字段名称集合。通过执行es=pd.read_csv(es_url,...)语句实现从指定网络地址直接读取数据文件并加载为DataFrame对象。其中参数index_col=0设定将第一列作为行索引;parse_dates=True确保对索引中的时间信息进行自动识别与转换;sep=;指明数据各字段间以分号作为分隔符;dayfirst=True表明日期格式采用日-月-年的排列方式,符合欧洲地区常用习惯;header=None表示原始数据中不包含列标题信息;skiprows=4指示程序跳过前四行内容,通常用于忽略说明性文字或空行;names=cols则明确使用预先定义的cols列表元素作为最终数据框的列名标识。该系列参数协同作用,实现了对特定格式远程数据文件的精准解析与结构化导入,保证了时间序列数据的正确对齐与后续处理的便利性。整个过程体现了数据预处理环节中对源文件格式特征的准确把握与参数配置的严谨性。

17、 es.tail()用于显示数据尾部最后五行,具体所示。

18、 将数据从另一数据集导入。

19、 从指定路径读取名为 vs.txt 的数据文件,并将其加载为数据集。设置第一列作为行索引,跳过前两行以识别表头信息,表明数据包含两行标题。在读取过程中,启用日期解析功能,确保将索引中的日期字符串正确转换为日期时间类型。数据字段之间通过逗号分隔,符合标准CSV格式。同时,指定日期格式采用日-月-年的顺序,适用于欧洲地区的日期表示习惯,确保如15/03/2023能被准确识别为3月15日而非15月3日。完成数据导入后,调用 info 方法查看该数据集的基本结构信息,包括总行数、列数、每列的数据类型以及非空值的数量等,有助于初步了解数据的完整性与格式分布情况,为后续的数据清洗和分析提供基础支持。整个过程实现了从文件读取到初步探查的完整流程,确保数据能够被高效、准确地载入并准备用于进一步处理。

评论

更多评论