9月22日晚间,DeepSeek宣布其线上模型已完成新一轮升级,当前版本为DeepSeek-V3.1-Terminus。此次更新包含两个运行模式:思考模型与非思考模式,两者均支持128k上下文长度,用户现已可在线体验。

根据官方发布的更新说明,deepseek-chat与deepseek-reasoner均已升级至DeepSeek-V3.1-Terminus版本。其中,deepseek-chat对应非思考模式,适用于常规对话任务;deepseek-reasoner则启用思考模式,适合需要深度推理的复杂场景。

本次升级在延续原有模型性能的基础上,结合用户反馈进行了多项优化,重点提升语言表达的一致性,有效减少了中英文混用及异常字符出现的情况。同时,进一步增强了Agent功能,在代码执行和信息检索方面,Code Agent与Search Agent的表现更加稳定高效。

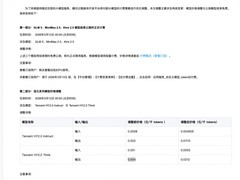

输出能力方面,非思考模型默认输出长度为4K tokens,最高支持8K tokens;思考模型默认输出32K tokens,最大可扩展至64K tokens。

在使用成本上,该模型按tokens计费:每百万输入tokens在缓存命中的情况下收费0.5元,未命中缓存则为4元;每百万输出tokens收费12元。

评论

更多评论